Automatizar tareas y mejorar la eficiencia de los profesionales de datos

Hay bastantes tareas rutinarias que un científico de datos o ingeniero de IA realiza como parte de su flujo de trabajo diario, como subir conjuntos de datos, ejecutar e iterar los mismos scripts para diferentes hiperparámetros, observar experimentos, y así sucesivamente. Descargar estas tareas en un agente de IA podría ahorrar recursos y añadir un valor significativo.

Ahí es donde entra en juego el Cloudera AI Workbench MCP Server : es un servidor de protocolo de contexto de modelo (MCP) de código abierto diseñado para integrarse mejor con tu flujo de trabajo agéntico.

Qué es Cloudera MCP Server y cómo ayuda

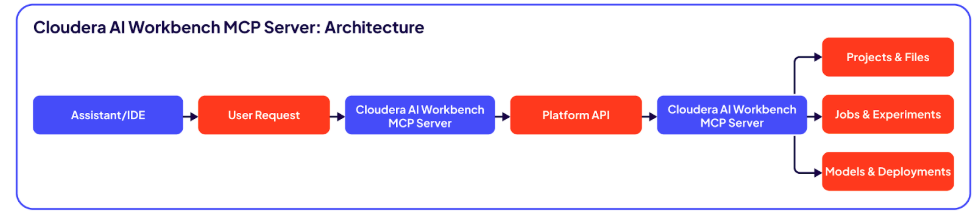

El servidor MCP de Cloudera actúa como un traductor seguro. Permite a los asistentes (como Cloudera Agent Studio, Claude o Cursor) ejecutar tareas directamente dentro de tu entorno Cloudera AI Workbench.

Esto significa que puedes pedirle a tu asistente que enumere proyectos, suba archivos y ejecute tareas, y el servidor llevará a cabo la acción utilizando las API estándar de la plataforma.

Figura 1. Cloudera AI Workbench MCP Server: Arquitectura

Se integra con el gobierno existente

Cloudera MCP Server está diseñado para funcionar con tu gobierno empresarial actual, no para eludirlo.

Para científicos de datos e ingenieros de IA: esto puede ayudar a reducir el cambio de contexto, lo que te permite permanecer en tu chat o IDE mientras inicia tareas de la plataforma. El asistente se encarga de la coordinación, mientras que la plataforma se encarga de la ejecución.

Para los equipos de plataforma y MLOps: ayudará a activar un script de evaluación, cargar nuevos conjuntos de datos y ejecutar ejecuciones de prueba similares. La integración también permite actualizaciones, eliminaciones de aplicaciones, reinicios y seguimientos de experimentos.

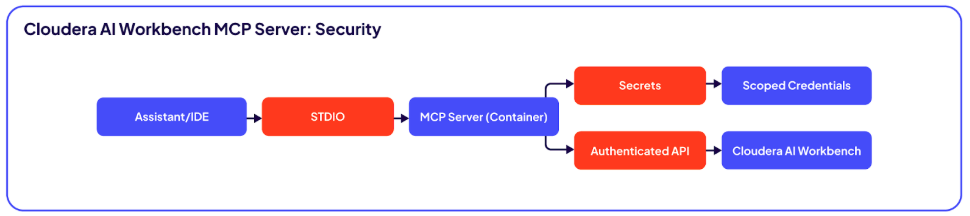

Seguridad por diseño

La seguridad es un componente central del diseño del servidor, pensado para encajar en un entorno empresarial.

Transporte STDIO: de forma predeterminada, utiliza la entrada/salida estándar (STDIO) para la comunicación entre el asistente y el servidor. Esto evita la necesidad de abrir y gestionar un nuevo punto final de red para esta interacción.

Gestión de credenciales: el servidor está diseñado para leer las credenciales de los secretos de Docker o de las variables de entorno, evitando la necesidad de codificar las claves o de pasarlas en los argumentos de la línea de comandos.

Fácil acceso: utiliza tus claves API existentes de Cloudera AI Workbench, permitiéndote definir los permisos adecuadamente para diferentes usuarios y casos de uso.

Figure 2. Cloudera Workbench MCP Server: seguridad por diseño

Cómo empezar con el servidor MCP de Cloudera

Cloudera MCP Server está diseñado para ayudar a tus asistentes a interactuar directamente con tu plataforma, todo ello mientras operan dentro de tu gobierno establecido.

Empezar es un proceso sencillo:

- Configura el servidor: ejecuta el servidor de código abierto en Docker, proporcionando tu host de Cloudera AI Workbench y la clave API como secretos

- Conecta a tu cliente: apunta tu cliente MCP preferido (como Cloudera Agent Studio) al servidor usando su comando STDIO

- Haz tu primera petición: puedes probar la conexión pidiéndole a tu asistente que "enumere mis proyectos"

Ejemplos de flujos de trabajo

Estos son algunos ejemplos de tareas que puedes realizar a través de un asistente conectado al Cloudera MCP Server:

Haz una lista de todos mis proyectos activos y muéstrame cualquier trabajo que siga funcionando

Sube el archivo new-data-august.zip al proyecto "detección de fraude"

Crea un trabajo con el script train-v3.py, dale 2 CPU y 8 GB de memoria y ejecútalo

Registra estas métricas en el experimento llamado “resnet-sweep” y etiqueta la ejecución con “new-data”.

Coge la última compilación del modelo y despliégala en el punto final de preparación

Reinicie la aplicación «gradio-demo»

El servidor incluye herramientas para apoyar estos flujos de trabajo a lo largo del ciclo de vida del proyecto, incluida la gestión de archivos, la ejecución de trabajos, el seguimiento de experimentos, el despliegue de modelos y la gestión de aplicaciones.

Más información

Para obtener pasos detallados de configuración, ejemplos y una lista completa de capacidades, visita el repositorio de GitHub del Cloudera MCP Server. Nota: Los proyectos de GitHub se proporcionan tal cual y no cuentan con el apoyo formal de Cloudera. El proyecto de Cloudera MCP Server se pone a disposición bajo la licencia Apache 2.0, y Cloudera no proporciona ninguna garantía, soporte o mantenimiento para su uso.

Para saber más sobre cómo MCP y Cloudera trabajan juntos, consulta nuestro blog Bringing Context to GenAI with Cloudera MCP Servers.